Molili接入Ollama本地大模型教程,一般无法使用Ollama的原因,是因为Ollama的权限问题。解决方法有2个。

解决方法1:

1、把Ollama升级到最新的版本,然后再试。

解决方法2:

核心解决方式:通过命令,打开Ollama的api调用权限。

1、先退出Ollama客户端

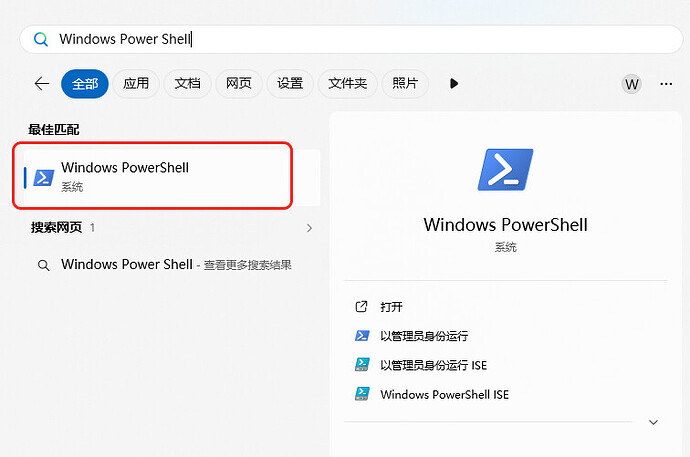

2、打开系统这个工具"Windows Power Shell"

3、执行命令1:

$env:OLLAMA_ORIGINS="*"

完成后执行命令2

ollama serve

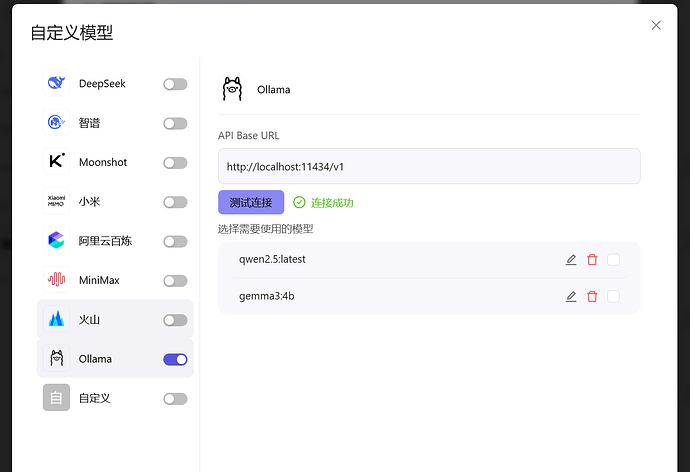

4、在molili自定义模型里,重新配置api base url

http://localhost:11434/v1

点击测试链接,下面出现可选模型,就说明成功了。(PS:如果没成功,试试手动启动一下Ollama客户端)