字节跳动今日宣布Doubao-Seed-2.0-lite升级至全新版本,这是豆包大模型家族中首款支持视频、图像、音频、文本原生统一理解的全模态模型,已在火山方舟平台上线开放调用。

新版本在视觉理解能力上有较大幅度提升,在物理、医疗等高阶学科推理任务中超越今年2月发布的Doubao-Seed-2.0-pro,在细粒度感知与具身理解等方向达到当前最优水平。音频方面,模型支持19个语种的语音转写及16个语种的互译,官方称其在语音识别、翻译等多项基准上优于Gemini-3.1-Pro。视频理解方面,模型可联合分析画面与音频信息,支持跨时间段追踪人物与事件,并执行多步逻辑推理。

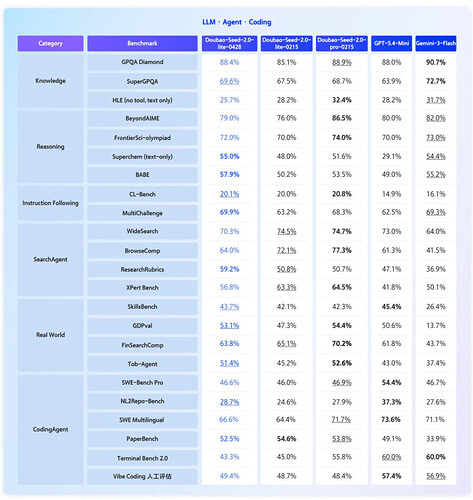

智能体与代码生成能力同步升级。模型对多轮、多步复杂指令的遵循度有所提升,深度适配OpenClaw、Hermes Agent等框架,代码能力覆盖前端页面、3D场景与游戏开发。GUI能力方面,模型将界面识别与操作执行打通,可完成点击、输入、滚动、拖拽等浏览器与桌面操作,支持跨应用连续执行业务流程。

官方同时表示,Doubao-Seed-2.0-mini全新版本也已同步上线,同样支持全模态理解,思考长度较上一版本大幅缩短,Token效率更高。字节跳动将该系列模型定位为企业在同等算力成本下大规模部署全模态推理任务的高性价比方案。