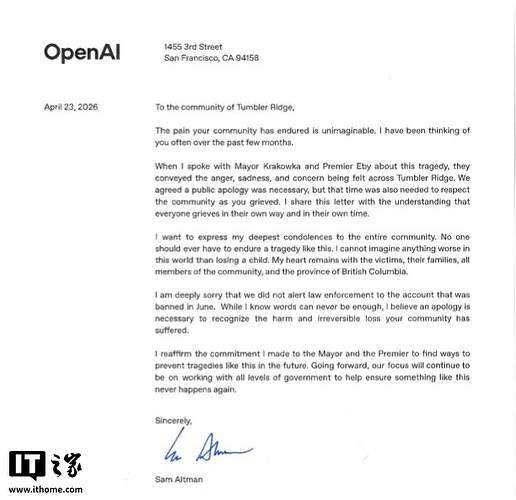

4 月 25 日消息,华尔街日报昨日(4 月 24 日)发布博文,报道称 OpenAI 首席执行官山姆 · 奥尔特曼(Sam Altman)致信加拿大坦布勒里奇镇(Tumbler Ridge),就未及时向警方通报大规模枪击案嫌疑人的活动记录正式道歉。

援引博文介绍,这起悲剧发生于今年 2 月,共造成 8 人死亡,嫌疑人为 18 岁的杰西 · 范鲁特塞拉尔(Jesse Van Rootselaar)。在 4 月 23 日的信函中,奥尔特曼表达了最深切的哀悼,并对公司未能更早采取行动表示歉意。

报道指出 OpenAI 的自动审核系统于 2025 年 6 月曾标记范鲁特塞拉尔的 ChatGPT 账户,因其信息涉及暴力场景描述,公司随即封禁了该账户。

部分员工将其内容视为现实暴力的潜在预警,并敦促领导层联系加拿大执法部门。然而,公司高层最终决定不向当局通报,这一决策在悲剧发生后引发了巨大争议。

警方在 2 月确认范鲁特塞拉尔为嫌疑人后,OpenAI 发现她还持有第二个 ChatGPT 账户。奥尔特曼在信中重申了此前对坦布勒里奇镇长及不列颠哥伦比亚省省长的承诺,即致力于寻找防止此类悲剧重演的方法。他表示,公司将继续与各级政府合作,确保类似事件不再发生。

OpenAI 表示,自枪击事件发生后,公司已加强安全协议。根据强化后的执法转介规则,如果再次发现类似范鲁特塞拉尔的账号行为,公司将把相关信息移交给执法部门。

不列颠哥伦比亚省省长戴维 · 伊比表示,公共安全部已获悉警方调查进入最后阶段。坦布勒里奇镇长达里尔 · 克拉科夫卡称,镇民仍在悲伤中,疗愈过程漫长而艰难。