frzyy

1

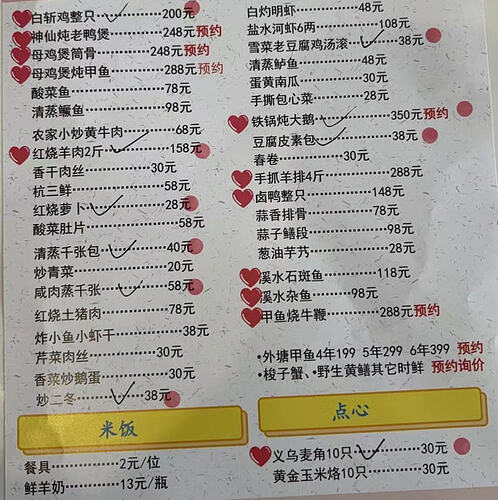

识别里面的"菜品名"与"点菜数量"只有出现黑色打勾的行才算点菜,如果价格“XX元”后面出现了手写数字,则该手写数字为“点菜数量”,否则“点菜数量”默认为1“菜品名”永远原样输出“·······”之前的文本,不要自行篡改菜品名,比如,严禁将“炒二冬”自行改名“炒冬笋”

只输出 YAML,严格使用以下格式:

菜品名A: 点菜数量

菜品名B: 点菜数量

举例:

溪水石斑鱼: 1

手抓羊排: 1

除 YAML本体 外不要输出任何解释、前后缀、标题或 Markdown code fence

试了下 GLM-5V-Turbo、qwen3.6plus、qwen3 VL plus、minimax2.7、kimi k2.5 、gemini3.1pro没一个能识别对的,难道是我姿势不对?

这玩意儿其实挺折腾的,我之前也试过,换了好几个模型,准确率都不行。后来发现可能是图片预处理的问题,得先把图片弄清晰点,对比度调高,手写数字单独做个区域检测,再喂给模型。直接扔张图进去,模型自己找关键信息,很容易出错。

是不是对图片分辨率有要求啊?小白问一下,会不会是上传的图太模糊了?

楼主试了那么多模型,有没有调整过 prompt 的写法?比如把“只有出现黑色打勾的行才算点菜”这句话放在更靠前的位置?另外,那个“·······”之前的文本提取,是用正则还是让模型自己切?我怀疑模型可能把点当成了省略号的一部分,导致截取出错。

你这要求也太细了,又要认勾又要选手写数字,还要原样输出菜品名。现在这些通用视觉模型,能大概看懂图里是菜单就不错了,细节规则还得自己写代码处理。我建议别指望一个模型全搞定,拆开几步:先检测表格行和勾的位置,再 OCR 识别文字,最后自己写逻辑判断数量和清洗菜名。

哎呦喂,又来这种帖子了,指望模型百分百按你定的规矩出牌?醒醒吧,还是得自己写规则兜底。

感觉这类场景对光线和角度要求很高,固定摄像头才好做

之前用过类似的方案,速度快不代表正确率高,手写体真是噩梦

对,OpenCV预处理加PaddleOCR定位再代码兜规则才稳