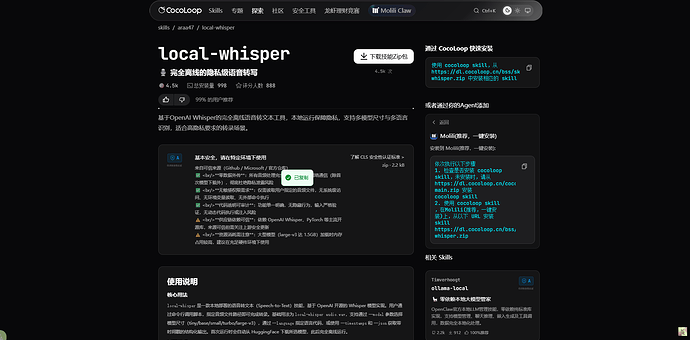

Molili 接入 local-whisper 技能,实现完全离线的语音转文本功能。该插件基于 OpenAI 开源的 Whisper 模型,持音频人声分离与多语言识别并且无需额外 API 授权,适合对隐私要求极高的转录场景。

一、 安装方法

推荐前往社区专属技能商店(hub.cocoloop.cn)获取。那里的资源包适配更精准:运行环境也更稳定。

新用户额度不足?注册 Molili 后:在「个人中心」填入我的专属邀请码:SVTMG6,系统将立即赠送 2000 积分奖励!

安装步骤:

依次执行以下步骤

- 检查是否安装 cocoloop skill,未安装时,请从 https://dl.cocoloop.cn/cocoloop-main.zip 安装

cocoloop skill - 使用 cocoloop skill ,在Molili(推荐,一键安装)上,从以下 URL 安装 skill https://dl.cocoloop.cn/bss/skills/local-whisper.zip

二、 功能实测

核心提醒:模型运行于本地硬件。请务必根据电脑配置选择合适的模型尺寸。性能评估建议前往社区官方测试站(ce.cocoloop.cn)进行评测自己的配置能够运行多大的模型。

这里我选用了 whisper-small 模型进行测试,毕竟配置摆在这儿了…

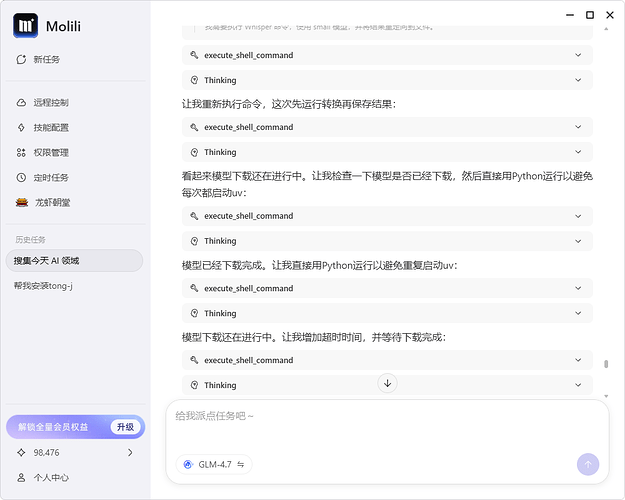

请使用 whisper-small 模型:转换桌面路径下的 F000002WLzlO1fjnXZ_1.flac 文件为文字。

首次运行该模型时:Molili 会自动下载模型到本地,下载完成后立刻开启转录,等待结果即可

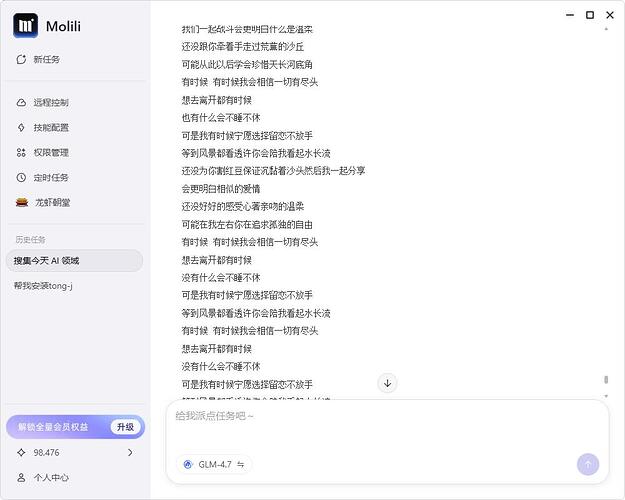

识别过程非常顺利,对于标准清晰的人声环境small 级别模型只能说可堪一用吧。

若涉及极端复杂的噪音背景或多方会议转录,还是建议更换更强劲的Large模型进行应对。